CoreAI · Mar 2024 — Present

AI Toolkit for VS Code

“AI エージェント開発を高速かつ快適に”

課題

AI 開発は断片化しており、遅い

本番 AI エージェントの構築には、複数のツール、プラットフォーム、ワークフローを使い分ける必要があります。開発者はモデルプロバイダー、テスト環境、デプロイパイプライン間のコンテキストスイッチに膨大な時間を浪費しています。

モデルの発見

適切なモデルを見つけるには、数十の個別プロバイダーポータルを巡り、異なるフォーマットでスペックを比較し、各候補を手動でテストする必要があります。

ツールの断片化

開発者はプロンプト用の Web UI、コーディング用の別の IDE、デプロイ用のターミナルツール、評価用の独立したダッシュボード間でコンテキストスイッチを繰り返しています。

エージェントのデバッグ

マルチステップのエージェントワークフローはブラックボックスです。エージェントが失敗した場合、ブレークポイントの設定、中間状態の検査、実行フローのトレースができません。

デプロイの障壁

動作するプロトタイプから本番環境への移行には、インフラの手動設定、個別の CI/CD パイプライン、深いクラウドプラットフォームの専門知識が必要です。

ユーザーペルソナ

AI アプリケーション開発者

AI 機能を本番アプリケーションに統合するフルスタック開発者。コーディングに精通していますが、プロンプトの高速イテレーション、モデル品質の評価、信頼性の高いエージェントの提供が求められます。

- 複数プロバイダーのモデルを一か所でテストする

- VS Code を離れずにエージェントを構築・デバッグする

- 最小限の設定でクラウドにデプロイする

ML エンジニア

モデルの最適化とファインチューニングを専門とするエンジニア。ドメイン固有タスク向けにオープンモデルをカスタマイズし、異なるハードウェアターゲット(CPU、GPU、NPU)でパフォーマンスをベンチマークするツールが必要です。

- ローカル GPU またはクラウドで QLoRA によるモデルのファインチューニング

- エッジデプロイ向けにモデルを変換・量子化する

- 実行プロバイダー間で推論パフォーマンスをプロファイリングする

シチズンデベロッパー

コードを書かずに AI 搭載機能をプロトタイプしたいプロダクトマネージャー、デザイナー、またはドメインエキスパート。アイデアを素早く検証するためのビジュアルで敷居の低いツールが必要です。

- ノーコードビルダーでプロンプトベースのエージェントを作成する

- 自然言語フィードバックでプロンプトをイテレーションする

- エンジニアリングへのハンドオフ用に本番対応コードをエクスポートする

ユーザージャーニー

アイデアからデプロイ済み AI エージェントへ

発見

モデルカタログを閲覧し、9 つ以上のプロバイダーからモデルを検索。機能、価格、レイテンシを横並びで比較。

ペインポイント: 各プロバイダーポータルを個別に訪問する必要がある

プロトタイプ

Playground でマルチモーダル入力を使ってモデルをテスト。Agent Builder でプロンプトを作成し、MCP ツールを接続。

ペインポイント: プロンプトとツールをイテレーションする統一された場所がない

構築とデバッグ

完全な IntelliSense でエージェントコードを記述。F5 で Agent Inspector を起動し、ブレークポイントとワークフロービジュアライゼーションを利用。

ペインポイント: エージェントワークフローが不透明でデバッグが困難

評価とデプロイ

組み込みメトリクスで一括評価を実行。ワンクリックで Microsoft Foundry にデプロイし、トレーシングを有効化。

ペインポイント: テストとデプロイで別々のツールチェーンを使用

ユーザーストーリー

As AI アプリケーション開発者

I want to OpenAI、Anthropic、オープンソースプロバイダーのモデルを単一インターフェースで比較したい

So that プロバイダーポータルを切り替えずに、ユースケースに最適なモデルを選択できる。

As プロダクトマネージャー

I want to ビジュアルなノーコードビルダーでプロンプトベースのエージェントを構築・テストしたい

So that エンジニアリングリソースを投入する前に AI 機能のアイデアを検証できる。

As ML エンジニア

I want to ドメイン固有データセットで QLoRA を使ってオープンモデルをファインチューニングしたい

So that 企業の専門用語やワークフローに対する精度を向上させられる。

As プラットフォームエンジニア

I want to ブレークポイントと実行トレーシングでマルチエージェントワークフローをデバッグしたい

So that 本番環境に到達する前にエージェントの障害箇所を特定し修正できる。

As Windows 開発者

I want to Copilot+ PC で NPU アクセラレーション向けにモデルを変換・最適化したい

So that クラウドに依存せず、高速なオフライン AI 体験を提供できる。

機能

モデルカタログ

Microsoft Foundry、GitHub、Hugging Face、ONNX、Ollama、OpenAI、Anthropic、Google、NVIDIA NIM にまたがる統合モデル発見。横並び比較とワンクリック Playground アクセス。

9 つ以上の統合モデルプロバイダー

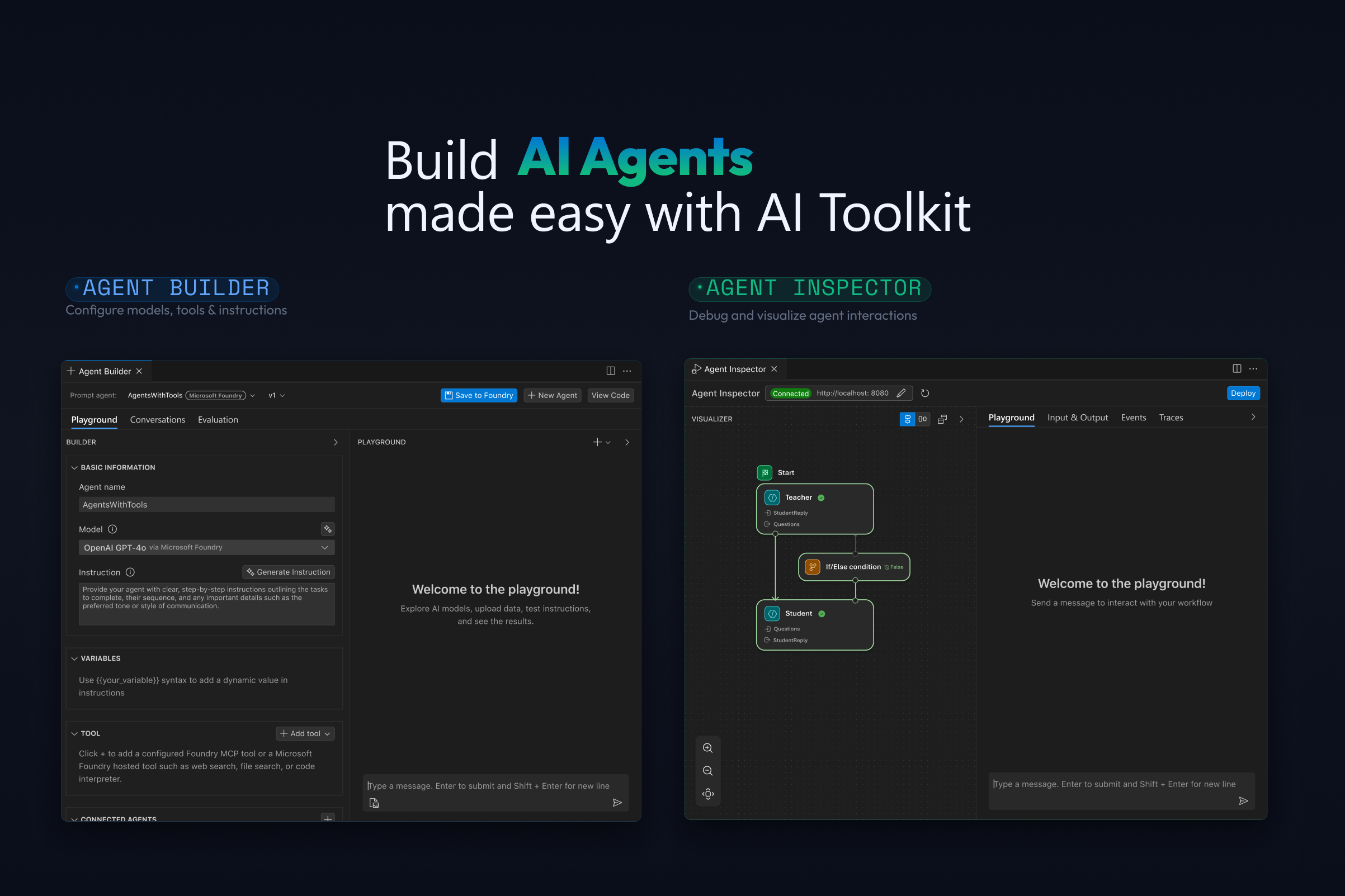

Agent Builder

プロンプトエージェントを作成するためのノーコードビジュアルインターフェース。自然言語プロンプトエンジニアリング、"Inspire Me" 生成、MCP ツール統合、構造化出力をサポート。

数分でゼロからエージェントへ

Agent Inspector

AI エージェント向けの完全な F5 デバッグ。ブレークポイント、リアルタイムストリーミング可視化、マルチエージェントワークフローグラフ、ワンクリックコードナビゲーションをサポート。

ファーストクラスのデバッガー統合

モデル評価

組み込みメトリクス(F1、関連性、類似度、一貫性)とカスタム評価器による一括評価。CI スタイルの品質ゲートとしての「テストとしての評価」。

定量化されたモデル品質

ファインチューニング

Azure Container Apps 経由でローカル GPU またはクラウドで QLoRA を使用してモデルをカスタマイズ。Phi、Llama、Mistral、DeepSeek、Copilot+ PC 向け NPU 最適化バリアントをサポート。

ローカル GPU + クラウドトレーニング

ワンクリックデプロイ

VS Code から Microsoft Foundry に直接エージェントをデプロイ。CPU、GPU、NPU にまたがる本番監視のための組み込みトレーシングとプロファイリング。

VS Code から本番環境へワンクリック

技術アーキテクチャ

クロスプラットフォーム対応

VS Code を通じて Windows、macOS、Linux で動作。ローカル推論は CPU、GPU (CUDA)、NPU ハードウェアアクセラレーションをサポートし、Copilot+ PC でのオフライン AI シナリオを実現。

プロバイダー非依存

単一インターフェースが 9 つ以上のモデルプロバイダーを抽象化。開発者はエージェントコードを変更せずにクラウドモデルとローカルモデルを切り替え可能で、ベンダーロックインを低減。

全ライフサイクルカバレッジ

モデル発見からファインチューニング、評価、デバッグ、クラウドデプロイまで -- AI 開発ライフサイクル全体が開発者が日常的に使うエディター内で完結。

関連プロジェクト

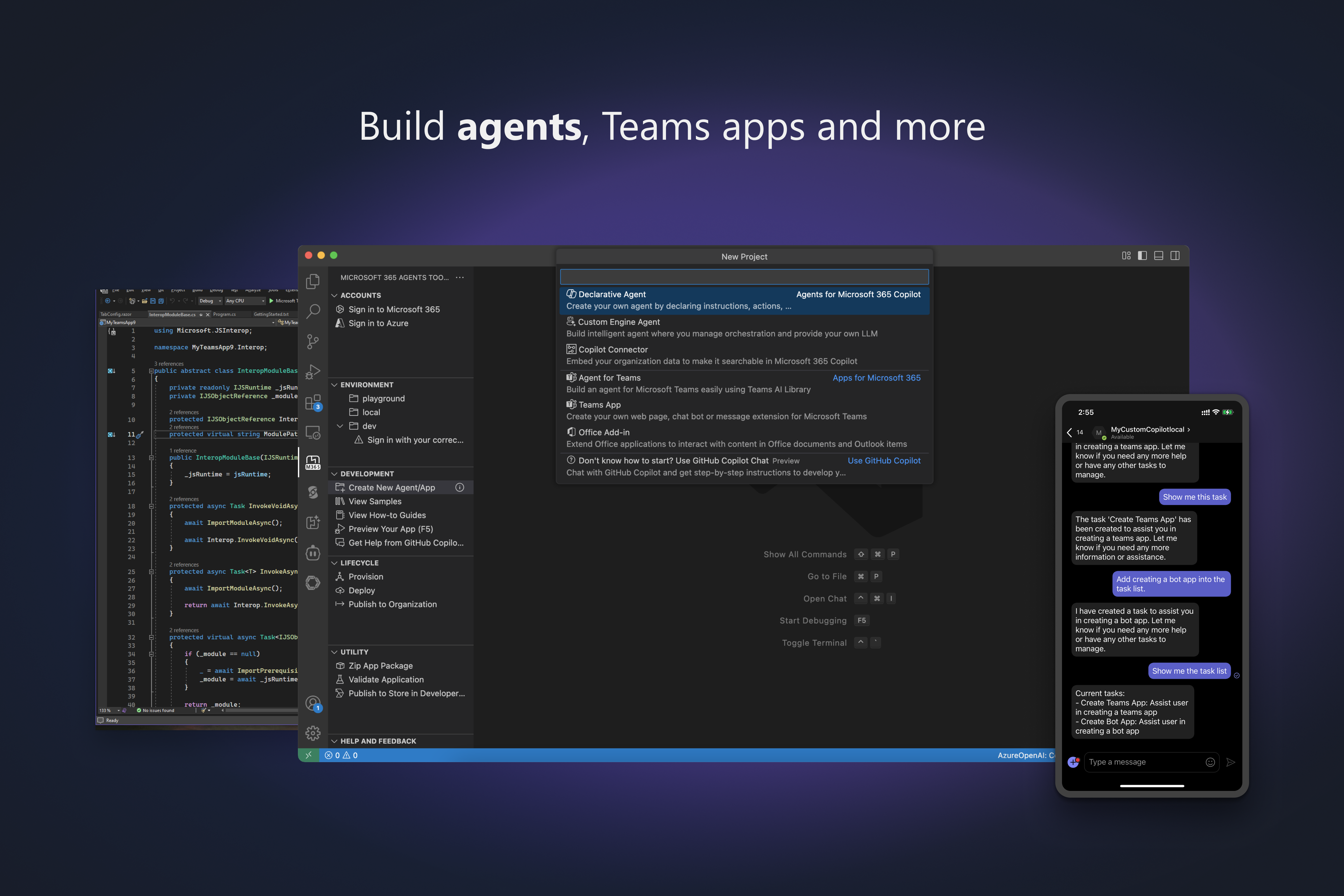

Microsoft 365 Agents Toolkit

Microsoft 365 向けに構築する企業開発者は、断片化された SDK、複雑な認証設定、プロジェクトごとの手動クラウドプロビジョニングに直面していました。Agents Toolkit はライフサイクル全体 -- スキャフォールド、デバッグ、デプロイ、公開 -- を効率化し、Teams、Copilot、Outlook で 2 万人以上の月間アクティブ開発者にサービスを提供しています。

ケーススタディを読む